El Sputnik, primer satélite artificial de la historia, no transmitía ningún dato científico de importancia. Se trataba de una esfera de aluminio brillante, casi espejada, que no sacaba fotos de la superficie terrestre ni llevaba instrumentos que justificaran el enorme esfuerzo que su construcción y lanzamiento habían demandado. A través de sus delgadas antenas solo emitía un pitido intermitente. Un pulso de radio agudo y nítido que permitía a cualquier radioaficionado en el mundo sintonizar su señal, prueba irrefutable de que el satélite estaba allí arriba, girando alrededor de la Tierra.

Puesto en órbita en octubre de 1957 por la Unión Soviética, detrás de esa aparente inutilidad se escondía su verdadera potencia. El Sputnik era un gesto político contundente que, con un simple “beep”, exhibía superioridad tecnológica y dominio de los cohetes, dos frentes estratégicos en plena guerra fría. Y al mismo tiempo extendía las fronteras de los territorios en disputa hacia el espacio exterior, una nueva dimensión geopolítica tan codiciada como el mar o el subsuelo.

Casi siete décadas después de aquel pitido, un extenso andamiaje de miles de satélites conecta nuestra civilización y sostiene gran parte de la vida moderna. Sistemas de navegación, observación científica, monitoreo y pronóstico climático, transmisiones televisivas y conexiones de internet dependen hoy de una compleja red de artefactos que orbitan la Tierra de manera permanente. Así, lo que durante siglos fue un vacío inalcanzable sobre nuestras cabezas, se convirtió lentamente en una parte fundamental de la infraestructura tecnológica; invisible para la mayoría de las personas, pero indispensable para el funcionamiento cotidiano del mundo.

Pero este entramado imperceptible está a punto de protagonizar su próxima evolución, empujado esta vez por la inteligencia artificial. La utilización y entrenamiento de los grandes modelos de lenguaje y los sistemas computacionales que los sostienen necesitan unas cantidades tan descomunales de energía y refrigeración, que están comenzando a rozar los límites de la infraestructura instalada. Mientras que en 2024 estos data centers consumían un promedio de 415 TWh, equivalentes al 1,5% de la electricidad mundial, se espera que en los próximos cuatro años alcancen más de 1050 TWh, equivalente al consumo de países enteros.

Las señales de estrés ya comenzaron a aparecer. David Mills, CEO de PJM Interconnection, el mayor operador energético de los Estados Unidos y responsable del abastecimiento para unos 67 millones de personas en 13 estados, advirtió el pasado miércoles 6 de mayo en una carta dirigida a sus accionistas que el sistema eléctrico “ya no es apto” para afrontar el crecimiento explosivo de la demanda impulsada por los grandes centros de datos. Según explicó, la red podría comenzar a sufrir escasez de electricidad incluso desde el próximo año, mientras que las empresas generadoras encuentran cada vez más dificultades para garantizar suficiente energía sin poner en riesgo el suministro destinado a hogares y usuarios tradicionales.

El problema ya comenzó a modificar incluso las políticas energéticas de algunos países. Dinamarca, uno de los grandes polos europeos para la instalación de centros de datos gracias a su clima frío y abundancia de energía renovable, empezó a debatir restricciones para nuevas instalaciones después de que el crecimiento explosivo de la demanda vinculada a la inteligencia artificial comenzara a exigir al máximo su infraestructura energética. En marzo, el operador estatal Energinet suspendió temporalmente nuevos acuerdos de conexión luego de recibir solicitudes equivalentes a unos 60 GW de consumo potencial, una cifra desproporcionada para un país cuyo pico de demanda ronda apenas los 7 GW.

Mientras tanto, en Alemania los data centers ya representan el 4% del consumo energético nacional, una cifra que podría trepar hasta el 10% hacia 2037 si el crecimiento actual continúa. El fenómeno se concentra especialmente en Frankfurt, uno de los principales nodos digitales de Europa, donde la proliferación de centros de datos comenzó a llevar la infraestructura energética local hacia un punto crítico. Según distintos operadores y autoridades del sector, las conexiones disponibles para los próximos años ya fueron asignadas y algunos nuevos proyectos podrían tener que esperar entre 7 a 12 años para conectarse a la red eléctrica.

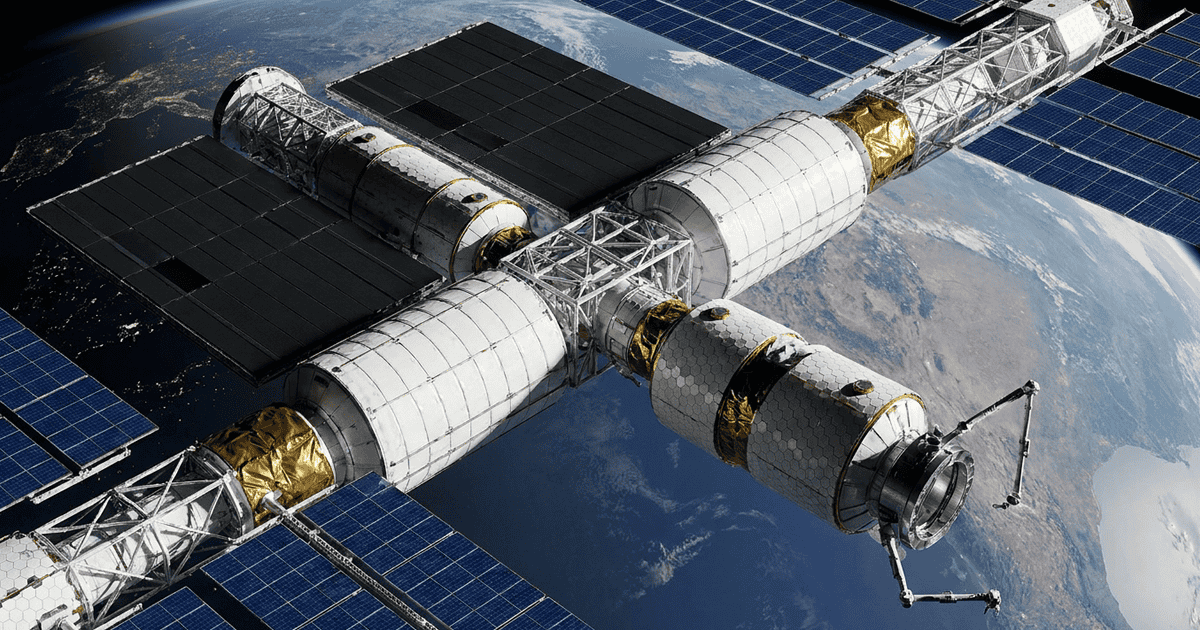

Ante este panorama, la posibilidad de trasladar parte de la infraestructura computacional fuera de la Tierra comenzó a discutirse con una seriedad que hasta hace pocos años parecía impensable. Lo que durante décadas fue apenas una idea futurista y propia de la ciencia ficción, empezó lentamente a transformarse en un desafío de ingeniería a resolver. Y algunas de las empresas de tecnología más poderosas del planeta empezaron a actuar en consecuencia.

La lógica detrás de estos proyectos parte de una ventaja imposible de reproducir sobre la superficie terrestre, y es que en el espacio la energía solar es prácticamente constante. Mientras que un centro de datos convencional depende de redes eléctricas al borde del colapso, una infraestructura orbital podría recibir luz solar casi de manera ininterrumpida durante el 99% del tiempo en determinadas órbitas heliosincrónicas, donde los satélites prácticamente nunca entrarían en la sombra de la Tierra. Además, al no existir atmósfera que disperse o absorba radiación, los paneles solares operando en el espacio pueden alcanzar niveles de eficiencia entre 5 y 10 veces superiores a los de sus equivalentes terrestres.

Pero si las ventajas energéticas parecen tan evidentes, la pregunta que surge es por qué la órbita terrestre todavía no está llena de servidores. La principal razón es el enorme desafío que significa evacuar el calor generado por los procesadores en el vacío espacial. Sin atmósfera, no se pueden utilizar sistemas tradicionales de convección como disipadores ni enfriamiento por aire o líquidos, como ocurre en la Tierra. La única opción es radiar el calor al espacio mediante enormes paneles, que pueden ser más pesados y costosos que los propios servidores.

Actualmente, poner en órbita un kilogramo cuesta entre 1.500 y 2.500 dólares, por lo que arrastrar toda esa masa muerta al espacio multiplica el costo por cada megavatio de cómputo hasta hacerlo económicamente inviable. Si construir un centro de datos en tierra ronda los 26 millones de dólares, llevar una capacidad equivalente al espacio, con los grandes radiadores necesarios para evacuar el calor, eleva la inversión por encima de los 70 millones. Los expertos estiman que la paridad con los centros de datos terrestres solo ocurrirá cuando el costo de lanzamiento caiga por debajo de los 200 dólares por kilo, un umbral que se espera alcanzar con vehículos como el Starship de SpaceX, una vez que estén plenamente operativos hacia mediados de la década de 2030.

Además, el espacio es un entorno extremadamente hostil. Fuera de la protección que brinda el campo magnético de la Tierra, la radiación cósmica y las erupciones solares degradan rápidamente los chips comerciales, además de provocar cambios involuntarios en los bits de memoria, corrompiendo datos o incluso desencadenando fallos totales en los procesadores.

A diferencia de un data center terrestre, donde un técnico con un destornillador puede reemplazar un componente en cuestión de minutos, en órbita cualquier intervención implica una operación compleja, costosa y, en muchos casos, directamente inviable. Cada servidor debe diseñarse para funcionar durante años sin mantenimiento, con sistemas redundantes y tolerancia a fallos, lo que incrementa aún más el peso, la complejidad y, en consecuencia, el costo de toda la infraestructura. Todo esto sin tener en cuenta que el avance tecnológico natural puede dejar obsoleta una inversión multimillonaria en órbita en muy poco tiempo, sin posibilidad de actualizarla.

Pese a estos desafíos técnicos y económicos, varias empresas decidieron avanzar, explorando este camino con pruebas reales. La más avanzada es Starcloud, que en noviembre de 2025 lanzó Starcloud-1, un satélite de 60 kg que llevó la primera GPU NVIDIA H100 al espacio y logró entrenar el primer modelo de lenguaje grande en órbita. Para finales de este año ya prepara el lanzamiento de Starcloud-2, un satélite mucho más potente con el que ofrecerá servicios de procesamiento en órbita para clientes como AWS y Google Cloud.

Otros grandes jugadores también se sumaron a esta apuesta. Google avanza con su proyecto Suncatcher, que busca evaluar la viabilidad operativa de estos centros de datos de inteligencia artificial en órbita. El gigante tecnológico planea lanzar, a principios de 2027, dos satélites prototipo en asociación con Planet Labs, una empresa fundada por ex científicos de la NASA, con el objetivo de probar cómo responden sus chips de IA en el entorno espacial.

Por su parte, SpaceX -tras la adquisición de xAI, la empresa de inteligencia artificial fundada por Elon Musk en 2023- presentó ante la FCC una solicitud para lanzar hasta un millón de satélites dedicados a funcionar como centros de datos orbitales para IA, una cifra que refleja la dimensión descomunal del proyecto. En febrero de este año, poco antes de la fusión, Musk aseguró en un podcast que “en 36 meses, probablemente más cerca de 30 meses, el lugar económicamente más atractivo para instalar IA será el espacio”, una de sus típicas predicciones extremadamente optimistas, acostumbrado a anunciar plazos que luego suelen extenderse.

Nadie sabe con certeza ni cuándo ni en qué escala los centros de datos orbitales pasarán de la fase experimental, pero el proceso ya está en marcha. Las variables son demasiadas, y el desafío tecnológico, enorme, aunque eso no lo vuelve irrealizable. Al fin y al cabo, el espacio lleva décadas alojando tecnologías que en su momento parecían imposibles de instalar ahí y hoy son indispensables. Las comunicaciones, la navegación y la observación climática siguieron ese mismo camino; comenzaron como proyectos experimentales y terminaron integrándose a la vida cotidiana. Lo que hoy parece una apuesta arriesgada podría, en pocos años, convertirse en una pieza fundamental para sostener un apetito energético que la Tierra ya no es capaz de garantizar.

Mundo

Tecnología

—

fuente: inteligencia artificial podría mudarse al espacio – Rosario3″> GOOGLE NEWS